Wat je moet weten over Responsible AI in Recruitment en HR

De snelle ontwikkelingen op het gebied van Artificial Intelligence hebben veel nieuwe kansen geopend. Echter, naarmate AI-systemen krachtiger worden, worden ze ook complexer en minder transparant. Bij onverantwoord gebruik kan deze technologie individuen of zelfs de samenleving als geheel benadelen.

Hoe kunnen we ervoor zorgen dat AI een positieve impact heeft en bias verminderen in de Recruitment en HR-industrie?

Tijdens een recent webinar hebben we het cruciale belang van ethisch gebruik van AI in deze industrie onderzocht. Deze discussie benadrukt de noodzaak dat AI-technologieën mensenrechten respecteren en hoge ethische normen naleven. Het benadrukt dat Responsible AI niet alleen een wettelijke vereiste is, maar ook een toewijding aan eerlijkheid, transparantie en verantwoording in alle recruitmentprocessen.

In dit artikel verkennen we de kernpunten van het webinar. We bespreken waarom Responsible AI een belangrijk onderwerp is in Recruitment en HR, wat het inhoudt, en welke belangrijke vragen je moet stellen bij het overwegen van Responsible AI.

Waarom we Responsible AI nodig hebben in recruitment

Toenemende complexiteit

Door de decennia heen zijn AI-systemen steeds complexer geworden. Ze begonnen als eenvoudige rule-based systemen in de jaren ’80 en ’90, maar het moderne AI-paradigma wordt ‘Machine Learning’ genoemd (of meer specifiek ‘Deep Learning’). Deze methode maakt gebruik van data en leert patronen hieruit. Dat we tegenwoordig indrukwekkende modellen zoals GPT hebben, komt grotendeels doordat deze zijn getraind op een enorme, onvoorstelbare hoeveelheid data en hiervoor gigantische computers zijn gebruikt.

Door de jaren heen werden deze systemen steeds complexer. Dit betekent ook dat we door deze toegenomen complexiteit het zicht verliezen op wat er binnen het systeem gebeurt.

“Als een rule-based systeem output X zou geven, zou het gemakkelijk zijn om via de regels terug te volgen waarom die beslissing werd genomen. Echter, als een LLM een bepaalde output geeft, is het bijna onmogelijk om precies vast te stellen waar die beslissing vandaan kwam.”

Deze toegevoegde complexiteit en verminderde interpretatie zijn belangrijke redenen waarom Responsible AI tegenwoordig steeds meer aandacht krijgt.

Toenemende impact

Naarmate AI in steeds meer systemen voorkomt, begint AI het leven van mensen in verschillende domeinen steeds meer te beïnvloeden. Als deze AI-systemen niet goed presteren, zullen bepaalde mensen benadeeld worden en negatief beïnvloed worden.

“Binnen het HR-domein is het redelijk te generaliseren dat mensen met goede communicatieve vaardigheden goed kunnen presteren in een verkooprol. Maar deze generalisaties kunnen ook leiden tot ongewenste vooroordelen, zoals onderscheid maken tussen mannelijke en vrouwelijke kandidaten of discriminatie op basis van etniciteit.”

Wat Responsible AI betekent in Recruitment

“AI zou de samenleving als geheel moeten dienen. Niet alleen de dienstverlener, het bureau of de kandidaat. Het kan en moet alle betrokken belanghebbenden ten goede komen. Dat is het kernprincipe van Responsible AI.”

Responsible AI is cruciaal in recruitment om bestaande vooroordelen niet te versterken of nieuwe te creëren. AI-systemen generaliseren van nature uit de data waarvan ze leren. Dit kan onbedoeld leiden tot discriminatie als het niet zorgvuldig wordt gecontroleerd. Responsible AI in HR betekent actief deze risico’s voorkomen om een eerlijke arbeidsmarkt te bevorderen. Dit houdt in dat AI-tools worden ontworpen om de besluitvorming te verbeteren zonder het menselijk oordeel te vervangen, zodat AI de recruitmentresultaten ondersteunt in plaats van dicteert.

AI-risico’s aanpakken

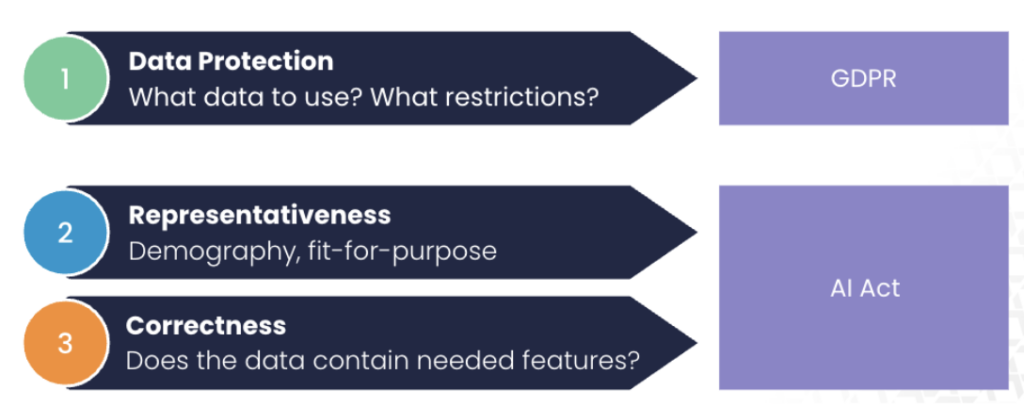

Om deze risico’s te beperken, moeten organisaties AI-systemen implementeren die eerlijkheid en transparantie vooropstellen. Dit houdt in dat de data die wordt gebruikt voor het trainen van AI grondig wordt gecontroleerd om ervoor te zorgen dat het geen bestaande maatschappelijke vooroordelen versterkt en dat er wordt voldaan aan strikte regelgevingsnormen zoals de AVG en de aankomende EU AI Act. Het is ook cruciaal om AI-modellen continu te auditen en te verfijnen om ervoor te zorgen dat ze in lijn blijven met ethische richtlijnen en presteren zoals bedoeld, zonder onbedoelde gevolgen.

Ethisch AI-ontwerp omvat de volgende principes:

- Eerlijkheid: AI moet iedereen eerlijk en onbevooroordeeld behandelen. In HR is eerlijkheid en niet discrimineren een essentieel kenmerk. Alle kandidaten moeten gelijk worden behandeld en alleen beoordeeld worden op hun verdiensten.

- Transparantie: AI moet tot op zekere hoogte verklaarbaar en interpreteerbaar zijn. Bijvoorbeeld, als een AI een kandidaat voor een baan aanbeveelt, moet het voor de gebruiker duidelijk zijn waarom die kandidaat geschikt is.

- Mensgericht: AI moet niet worden ontworpen om het hele proces van begin tot eind over te nemen. Het moet worden ontworpen om mensen te helpen bij hun dagelijkse taken.

Drie vragen over Responsible AI in de praktijk

Een praktische aanpak voor het implementeren van Responsible AI omvat het stellen van drie cruciale vragen:

- Welke trainingsdata wordt gebruikt? Elk machine learning-systeem begint met data. Bij verantwoord gebruik van AI moet de gebruikte data aan bepaalde standaarden voldoen.

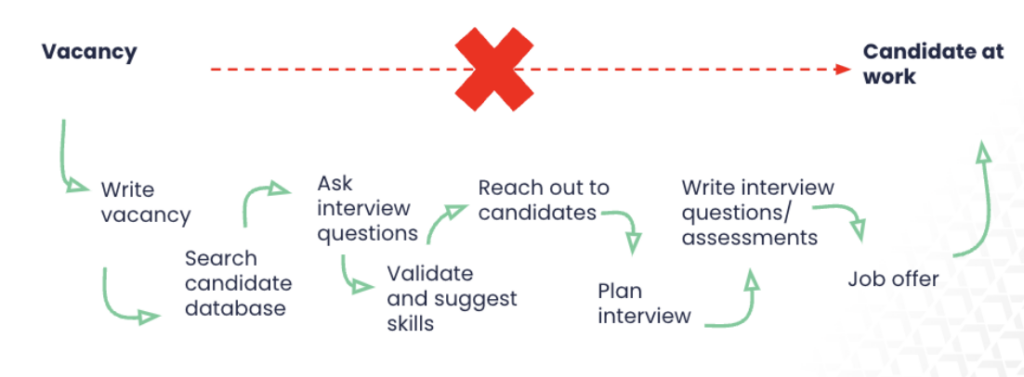

- Welke recruitmentprocessen automatiseer je? De reikwijdte van een enkel AI-systeem bepaalt voor een groot deel het risico dat ermee gepaard gaat. Een AI-model dat een end-to-end match tussen kandidaat en baan maakt, brengt een veel hoger risico met zich mee dan een AI-model dat een van de deeltaken van dit proces uitvoert.

- Je verliest veel transparantie als je geen tussentijdse outputs krijgt. Als gebruiker kun je de redenering of waarheidsgetrouwheid van het model niet controleren.

- Bij de split-task aanpak hebben we de mogelijkheid om tijdens het proces in te grijpen. Als een stap in de pipeline verkeerde resultaten oplevert, kunnen we dit gemakkelijk identificeren, meten en indien nodig corrigeren.

- De gebruiker kan even goed of zelfs beter presteren met subtaken die eenvoudiger en daardoor transparanter AI-modellen gebruiken.

- Hoe behoudt de gebruiker de controle? LLM’s bieden zeer krachtige mogelijkheden. Bij Textkernel geloven we dat zij de toekomst zijn, en dat ze onze processen kunnen verbeteren wanneer ze zorgvuldig worden geïmplementeerd.

Hier is een van de verschillende voorbeelden waarbij LLM’s een rol spelen in Textkernel producten:

In dit voorbeeld kun je met LLM’s een Google-achtige vrije-tekst zoekopdracht invoeren. De LLM interpreteert de input en bouwt direct de juiste Textkernel-zoekopdracht, waardoor onze producten nog gebruiksvriendelijker worden, vooral voor nieuwe gebruikers.

Zo profiteren we van de kracht van LLM’s, zonder concessies te doen aan transparantie en eerlijkheid.

Responsible AI integreren in Recruitment

De integratie van AI in HR-praktijken biedt enorme mogelijkheden, maar brengt ook aanzienlijke ethische uitdagingen met zich mee. Organisaties moeten deze uitdagingen niet alleen begrijpen, maar zich ook actief inzetten voor de ontwikkeling van AI-systemen die transparant, eerlijk en verantwoord zijn. Door zich te committeren aan ethische AI-praktijken, bouwen ze vertrouwen in deze technologieën op, waardoor ze waardevolle hulpmiddelen worden in het recruitment- en HR-landschap.

Bekijk het on-demand webinar “What you didn’t know about Responsible AI” voor een diepgaander begrip van Responsible AI in recruitment.

Textkernel loopt al meer dan 20 jaar voorop in AI. We zijn trotse members en bijdragers aan het Koninklijk Nederlands Normalisatie Instituut, specifiek de Normalisatiecommissie voor AI & Big Data, en helpen de normen vorm te geven die bepalen hoe organisaties de AI Act in de praktijk moeten implementeren. Leer meer over Responsible AI.

Auteur: Vincent Slot

Team Lead R&D

Vincent leidt de technische aspecten van de Responsible AI-inspanningen binnen Textkernel. Hij is lid van de AI & Big Data-commissie van het Koninklijk Nederlands Normalisatie Instituut, waar hij bijdraagt aan het creëren van Europese normen voor de implementatie van de EU AI Act voor organisaties.

Lees meer over AI:

- Textkernel doorstaat audit van de NYC AI-wet

- Skills-based matching met AI: kansen en valkuilen

- Hoe generatieve AI skills-based recruitment onvermijdelijk maakt

- Transparantie in AI: waar moet je op letten?